Drohnen: Verletzte bei Großschadensereignissen finden

Herzschlag und Atemfrequenz einer Person via Radar zu messen, ist nichts Neues. Nun ist es Forschenden jedoch gelungen, die Vitalparameter per Radar von einer bewegten Drohne aus zu erfassen. Interessant ist das vor allem bei Großschadensereignissen wie Erdbeben oder Bränden.

Stürzt ein Gebäude bei einem Erdbeben in sich zusammen, ist es für Rettungskräfte vielfach zu gefährlich, den Bau zu betreten, um darin nach Verletzten zu suchen. Systeme, die die Einsatzkräfte bei der Erkundung von Schadensstellen unterstützen, sind daher dringend gefragt. Geeignet sind vor allem drohnengetragene Systeme: Bestückt mit Radarsensoren, könnten Drohnen in die Gebäude hineinfliegen und dort Verletzte aufspüren. Entsprechende drohnenbasierte Sensorik wurde von einem deutsch-österreichischen Konsortium im BMBF-Projekt »UAV-Rescue« entwickelt – unter der Leitung des Fraunhofer FHR. Mit dabei waren unter anderem das Technische Hilfswerk THW, die Leibniz-Universität Hannover LUH, das Fraunhofer EMI sowie die Ruhruniversität Bochum.

Vitalparameter via Radar auf bewegter Drohne messen

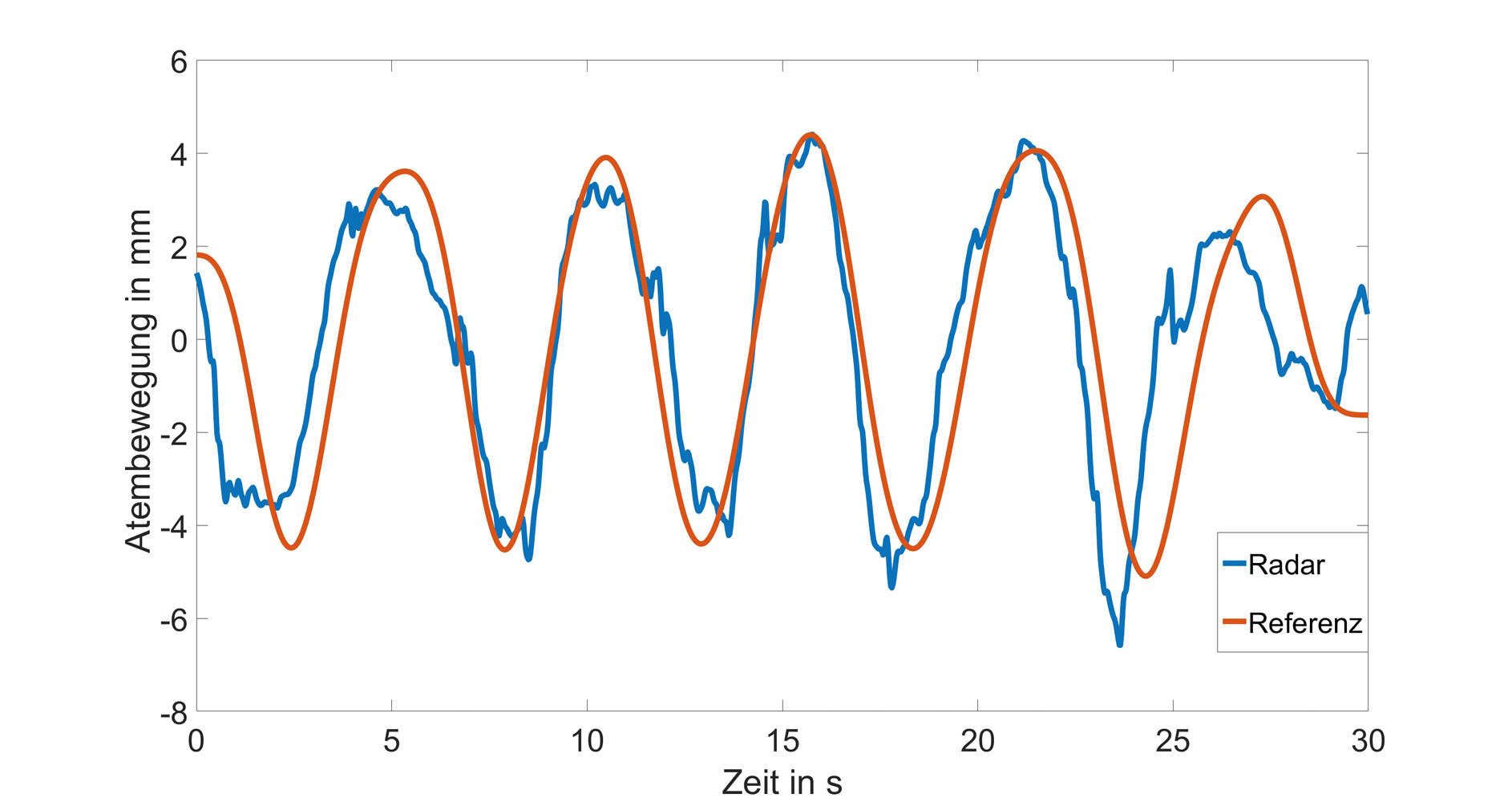

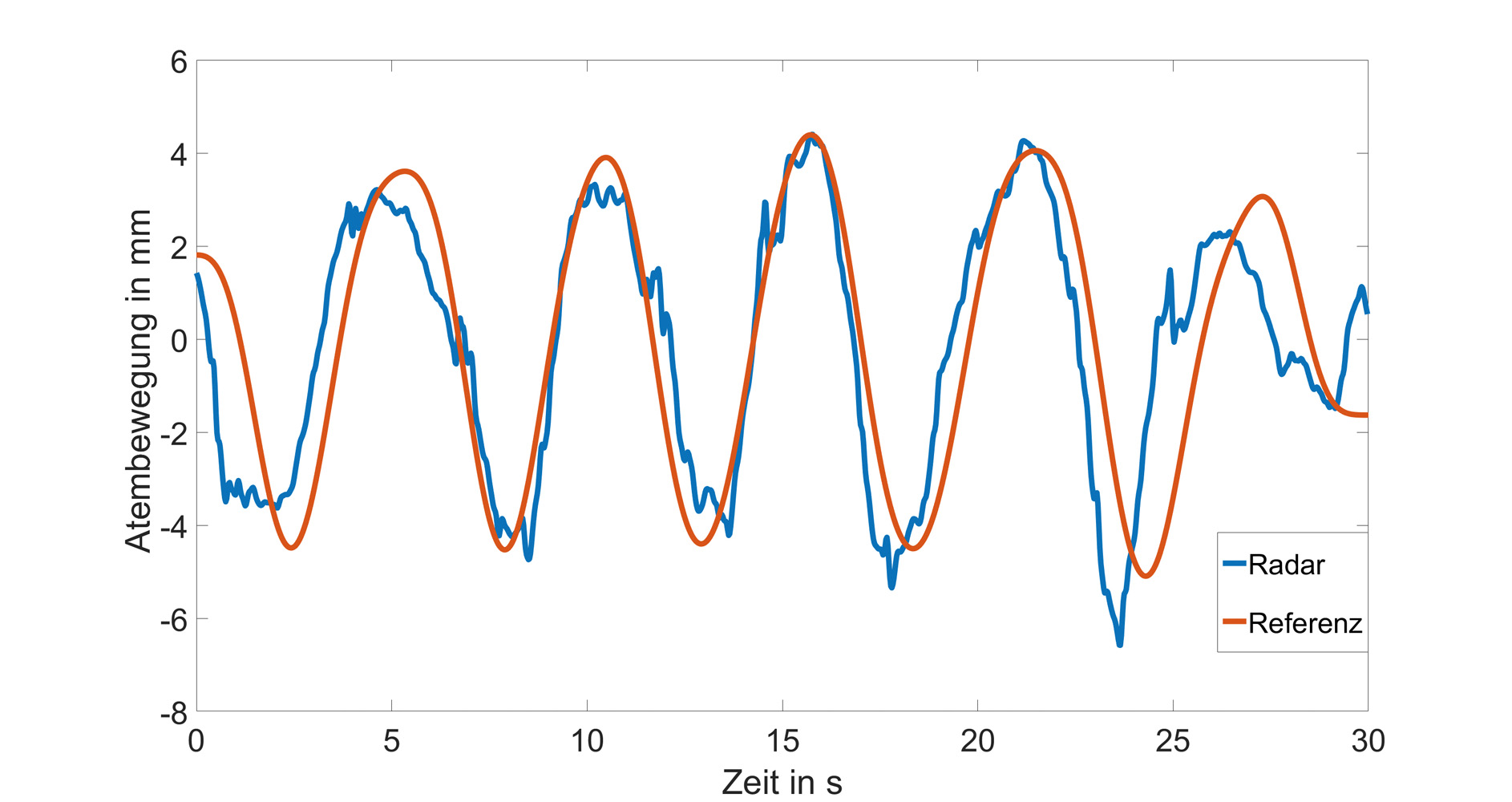

Während die österreichischen Forschenden das Katastrophengebiet von oben mit einem LIDAR-System analysierten und kartografierten, arbeitete das deutsche Team an einer kleineren Drohne, die beladen mit Radar und Lidar in das zerstörte Gebäude hineinfliegt. Sie kartografiert den Bau von innen und sucht nach verletzten Personen. Die Forschenden des Fraunhofer FHR konzentrierten sich dabei auf die Detektion der Vitalparameter. Herzschlag und Atemfrequenz via Radar zu analysieren, ist Stand der Technik – bislang allerdings stets von feststehenden Radarsystemen aus. Dabei analysiert man die Frequenz, mit der sich die Brust einer Person beim Ein- und Ausatmen bzw. durch den Herzschlag hebt und senkt. Die Forschenden konnten nun (erstmals) Vitalparameter von einem bewegten Radarsystem aufzeichnen. Keine einfache Aufgabe: Die Drohne bewegt sich innerhalb von ein bis zwei Sekunden rund 20 Zentimeter, die Atembewegung dagegen liegt im Bereich eines Zentimeters – selbst wenn die Drohne auf einer Stelle schwebt, ist ihre Bewegung größer als die zu detektierende.

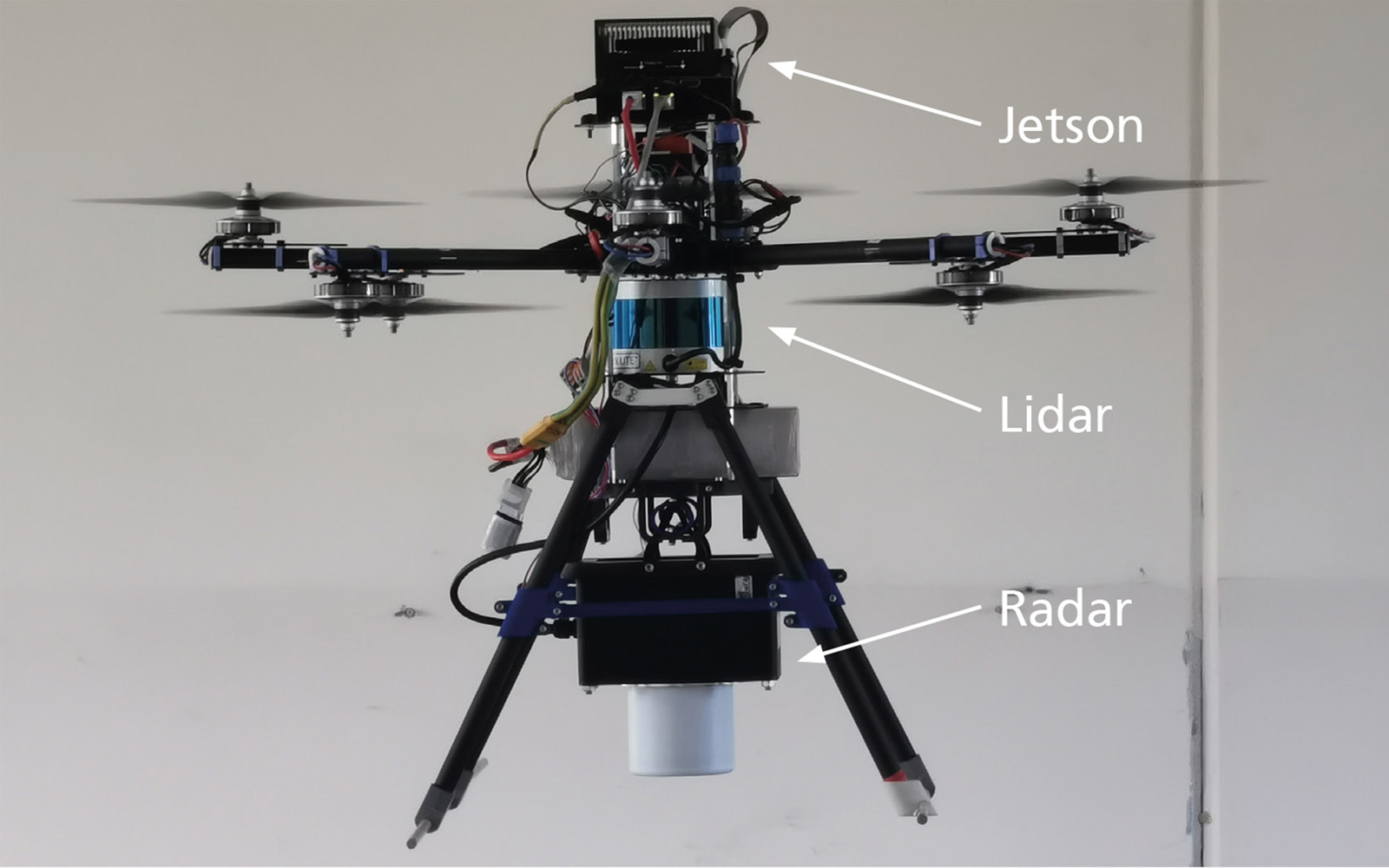

Wie also lassen sich die Vitalparameter dennoch auflösen? Die Kernidee: Im Gebäude sieht das rotierende Radar größtenteils Objekte, die sich nicht bewegen, etwa Wände. Dennoch erscheint es dem Radar durch die Eigenbewegung der Drohne, als bewegen sich die Wände auf das Radar zu oder von ihm weg. Die Forschenden nutzen daher feststehende Objekte, um die Bewegung der Drohne zu analysieren, und rechnen diese Bewegung aus den Gesamt-Radardaten heraus. Die übrigen Ziele werden ausgewertet: Sind darin Vitalparameter enthalten? Ist die Frequenz eines Herzschlags oder des Atems einer Person darin erkennbar? Um solche Analysen in Echtzeit durchführen zu können, trägt die Drohne nicht nur Radarsensoren – gestellt vom Projektpartner Indurad – und Lidarsysteme, sondern auch einen kleinen Jetson-Computer, der die erfassten Signale verarbeitet. Die Position der Drohne, eine Umgebungskarte, die Lokalisation der Person sowie Bewegungsinformationen, aus denen die Vitalparameter abgeleitet werden können, funkt die Drohne nach draußen an die Rettungskräfte.

Erste Funktionstests erfolgreich bestanden

Ein fliegender Demonstrator ist entwickelt, dieser konnte bereits wiederholt Vitalparameter messen – von der bewegten Drohne aus: im Jahr 2022 bei einer Messkampagne in Österreich, Ende Juni 2023 in Mosbach sowie bei der Abschlusspräsentation des Projekts in Österreich im Juli 2023. Er erstellte eine Karte des Gebäudes, spürte eine Person darin auf, detektierte deren Vitalparameter und zeigte die Position der Person auf der Karte an. Künftige Forschungsarbeit bleibt dennoch genügend: Etwa drei bis fünf Jahre dürften noch nötig sein, um das System in Richtung Produktreife zu bringen. Insbesondere die Robustheit des Systems könnte in künftigen Projekten auf der Agenda stehen.